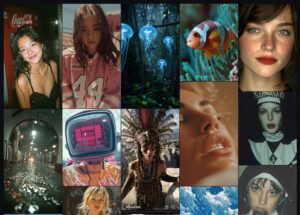

Midjourney lanza su modelo de vídeo V1 y entra en la carrera por liderar la generación audiovisual por IA

La herramienta permite animar imágenes estáticas en segundos y se suma a la competencia con Sora (OpenAI), Veo (Google) y Kling (ByteDance) Midjourney, conocida por su plataforma de generación de imágenes mediante inteligencia artificial, ha dado un salto importante con el lanzamiento de V1, su primer modelo de vídeo. Esta nueva herramienta permite animar imágenes estáticas en clips de cinco