En los últimos meses, las herramientas de inteligencia artificial (IA) se han vuelto cada vez más populares. Muchas personas ya han probado aplicaciones como ChatGPT, Bard o Copilot, capaces de responder preguntas, escribir textos, resumir artículos o ayudarte con tareas escolares o del trabajo. Todo parece mágico… hasta que un día, sin darte cuenta, la IA te da una respuesta falsa y tú te la crees. ¿Qué ha pasado ahí?

Eso tiene un nombre: alucinaciones de la inteligencia artificial.

¿Qué significa que una IA “alucine”?

En el mundo de la inteligencia artificial, una alucinación no es un problema visual ni un error técnico del ordenador. Es cuando la IA se inventa información que parece real, pero no lo es.

Por ejemplo:

- Te dice que un libro fue escrito por alguien que nunca lo escribió.

- Te da una cita que suena bien… pero que nunca existió.

- Te menciona una ley o una noticia falsa como si fuera cierta.

Lo más peligroso es que lo dice de forma clara, segura y bien redactada. Y como lo dice con tanta seguridad, tú te lo crees.

¿Por qué ocurre esto?

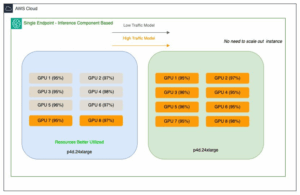

Porque la IA no sabe lo que dice, aunque lo parezca. No tiene conciencia ni entiende el mundo como los humanos. Lo que hace es predecir qué palabras deben ir después de otras, basándose en millones de textos con los que ha aprendido.

Es decir, no está comprobando datos en una enciclopedia ni haciendo búsquedas reales. Simplemente genera texto que “suena bien” y que “tiene sentido” según los patrones que aprendió. Si no sabe algo, se lo puede inventar sin que tú lo notes.

¿Puede ser peligroso?

Sí, dependiendo de para qué uses la IA. Algunos ejemplos reales:

- Un abogado en EE.UU. presentó un informe legal con citas falsas, inventadas por ChatGPT. El juez se dio cuenta y lo sancionó.

- Estudiantes han entregado trabajos escolares con referencias a libros o artículos que no existen.

- Personas han tomado consejos de salud de la IA sin verificar con un médico, lo que puede ser muy arriesgado.

La IA no tiene maldad, pero puede cometer errores muy convincentes.

¿Por qué la gente se deja engañar?

Porque el texto que genera suena profesional, está bien escrito y parece confiable. Además, muchas personas piensan que si lo dice una “inteligencia artificial”, debe ser verdad. Pero no es así. La IA no tiene sentido común ni conciencia. Solo escribe lo más probable, no lo más correcto.

¿Cómo evitar que te engañe?

Aquí van algunos consejos sencillos para todo el mundo:

✅ No creas todo lo que dice una IA. Siempre duda un poco.

✅ Verifica los datos importantes en otras fuentes. Busca en Google, Wikipedia o sitios oficiales.

✅ Pide enlaces o referencias, y comprueba si existen.

✅ Si algo suena raro, probablemente lo sea.

Entonces… ¿la IA miente?

No exactamente. No tiene intención de mentir. No piensa, no sabe lo que está bien o mal, y no tiene emociones. Solo hace lo que fue diseñada para hacer: escribir texto que suene natural. Pero como ese texto puede estar lleno de errores, depende de nosotros comprobarlo.

En resumen

- Las alucinaciones de la IA son errores inventados que suenan verdaderos.

- Pueden parecer inofensivos, pero pueden causar problemas si los tomamos como ciertos.

- La IA es útil, pero no es perfecta. Hay que usarla con cuidado.

Usa la inteligencia artificial como una herramienta, no como la verdad absoluta. Porque a veces, hasta la IA más lista… se lo inventa todo.

Referencia: Noticias inteligencia artificial y Redes-Sociales.com