El desarrollo de la inteligencia artificial generativa y los modelos de lenguaje grande (LLMs, por sus siglas en inglés) está generando una revolución en el mundo corporativo, permitiendo a las organizaciones mejorar la experiencia del cliente de forma mucho más rápida que con los métodos tradicionales que requerían años de esfuerzo. Actualmente, las empresas gestionan grandes volúmenes de datos, tanto almacenados localmente como en la nube.

Una de las maneras más efectivas de aprovechar esta tecnología es transformando los datos existentes en índices aptos para el procesamiento de inteligencia artificial generativa. A diferencia de las respuestas obtenidas por preguntar a un LLM de código abierto, que solo accede a información públicamente disponible, la generación de inteligencia artificial puede proporcionar un conocimiento más completo de los datos, enriquecido con contexto adicional por medio de técnicas como la Generación Aumentada por Recuperación (RAG, por sus siglas en inglés).

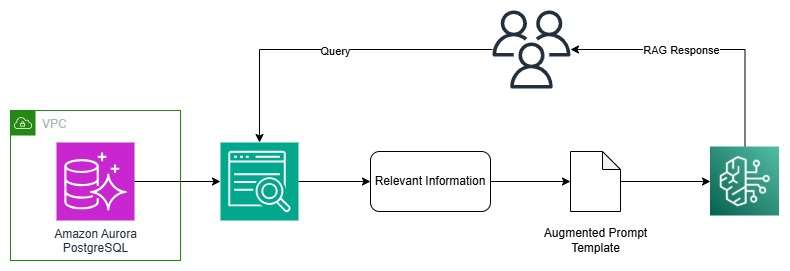

La técnica RAG permite obtener datos de una base de conocimiento ya existente dentro de la organización, y, al combinarlos con el conocimiento adquirido por el LLM, se generan respuestas más naturales y coherentes. A pesar de sus beneficios, para implementarla es necesario preparar los datos de la organización, lo cual puede representar un desafío considerable.

En este contexto, Amazon Aurora, una base de datos relacional que ofrece compatibilidad con MySQL y PostgreSQL, se ha diseñado para optimizar el uso en entornos de nube. Aurora junta lo mejor de las bases de datos empresariales tradicionales en término de eficacia y disponibilidad, con la sencillez y rentabilidad de las de código abierto, convirtiéndose en una herramienta clave para transformar datos en recursos valiosos.

Un ejemplo de esta integración consiste en utilizar los datos ya presentes en Aurora como base para desarrollar un servicio de búsqueda inteligente, conectando y sincronizando estos datos con Amazon Kendra. Esta configuración permite realizar búsquedas generativas de datos usando RAG para generar respuestas precisas y enriquecidas, combinando la información organizacional con el conocimiento de los LLMs.

El proceso para implementar esta tecnología incluye la creación de un clúster de Aurora PostgreSQL, la ingesta de datos en esta base de datos, el establecimiento de un índice en Amazon Kendra, y la configuración de un conector de Aurora PostgreSQL en Kendra para fusionar ambos sistemas. Tras sincronizar el índice Kendra con los datos de Aurora, se habilita la búsqueda inteligente y la producción de respuestas mejoradas interactuando con inteligencia artificial.

La adopción de este enfoque no solo minimiza la necesidad de preparar datos previamente para su empleo en servicios de búsqueda, sino que también acelera el desarrollo de aplicaciones de inteligencia generativa. Gracias a ello, las organizaciones pueden progresar en su transformación digital y optimizar el servicio al cliente de manera más efectiva.