Amazon ha anunciado la disponibilidad general de su innovadora herramienta de filtros de contenido de imagen en Amazon Bedrock Guardrails. Esta solución ofrece la capacidad de moderar tanto texto como imágenes dentro de aplicaciones de inteligencia artificial generativa, ampliando así las posibilidades de control de contenido, que anteriormente se limitaban solo a texto. Este avance promete facilitar una gestión más efectiva de los insumos y las respuestas generadas por la inteligencia artificial.

Tero Hottinen, Vicepresidente de Alianzas Estratégicas en KONE, expresó que esta innovación es fundamental para proteger aplicaciones de inteligencia artificial generativa, especialmente al verificar la relevancia y el contexto de la información. KONE planea incorporar diagramas de diseño y manuales en sus aplicaciones, usando Bedrock Guardrails para mejorar el diagnóstico y análisis de contenido multimodal.

Amazon Bedrock Guardrails permite a los usuarios establecer salvaguardias configurables para bloquear inputs y outputs dañinos. Incluye seis políticas distintas, desde filtros de contenido hasta la detección de alucinaciones del modelo, lo que ayuda a eliminar hasta el 88% del contenido multimodal perjudicial. La herramienta ofrece la opción de combinar la moderación de texto e imágenes, ajustando los niveles de tolerancia de contenido de bajo a alto.

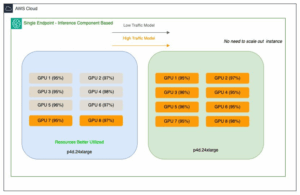

La funcionalidad está disponible en diversas regiones de AWS, como US East, US West, Europa y Asia-Pacífico, beneficiando a organizaciones en sectores como la salud, manufactura, servicios financieros, medios de comunicación y educación. Estas industrias pueden ahora mejorar la seguridad de marca sin recurrir a salvaguardias personalizadas o evaluaciones manuales propensas a errores.

Para utilizar estos filtros de contenido de imagen, los usuarios deben crear un guardrail en la consola de gestión de AWS y configurar los filtros que deseen. Además, pueden usar el API independiente, ApplyGuardrail, para validar contenido en cualquier flujo de aplicación.

Esta herramienta representa un avance significativo hacia un uso más seguro y responsable de la inteligencia artificial, permitiendo el desarrollo de aplicaciones que cumplan con las políticas de IA responsable de cada organización.