El auge de los modelos de lenguaje de gran tamaño, como el Meta Llama 3.1, ha impulsado la búsqueda de soluciones escalables, confiables y rentables para su implementación y operación. En este contexto, las instancias basadas en AWS Trainium e Inferentia, junto con el Amazon Elastic Kubernetes Service (Amazon EKS), se presentan como un marco de alto rendimiento y bajo costo para ejecutar estos modelos efectivamente en un entorno de contenedores.

Para desplegar el modelo Meta Llama 3.1-8B, se requiere el uso de instancias Inferentia 2 a través de Amazon EKS. Este proceso implica varios pasos clave: la creación del clúster EKS, la configuración del grupo de nodos Inferentia 2, la instalación del complemento de dispositivo Neuron y la extensión de programación. Además, es esencial preparar la imagen Docker necesaria y proceder al despliegue del modelo.

El procedimiento también aborda métodos para probar la solución, monitorizar su rendimiento y discutir opciones para escalado y multi-tenancy. Antes de iniciar, es crucial contar con las utilidades necesarias en el entorno local o de desarrollo y asegurarse de que se tiene una cuota de servicio adecuada para utilizar instancias como inf2.48xlarge.

La creación de un clúster EKS requiere una configuración meticulosa, comenzando por el archivo adecuado y los comandos que permitan la instalación de componentes necesarios para una comunicación óptima entre los dispositivos Neuron y Kubernetes. Este proceso involucra la ejecución de un archivo YAML con todos los parámetros necesarios para definir el clúster conforme a necesidades específicas.

La instalación del complemento de dispositivos Neuron y la extensión de programación es vital para exponer los núcleos y dispositivos Neuron como recursos manejables en Kubernetes, optimizando la ejecución de pods que requieren múltiples núcleos o dispositivos Neuron. La preparación de una imagen Docker personalizada asegura que los requisitos de dependencia sean cumplidos para ejecutar el modelo eficazmente.

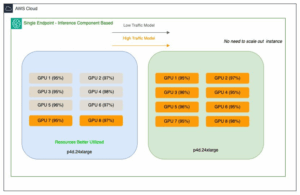

Para desplegar el modelo Meta Llama 3.1-8B, es necesario asegurarse de que la especificación de despliegue solicite los recursos adecuados y configure múltiples réplicas. Esto mejora el rendimiento de las inferencias y permite manejar múltiples solicitudes concurrentes de manera eficiente.

La monitorización del despliegue y la verificación de su disponibilidad se realizan mediante configuraciones adecuadas y pruebas de rendimiento, apoyándose en herramientas como AWS Neuron Monitor, Prometheus y Grafana para obtener visualizaciones avanzadas del rendimiento.

A medida que crece la demanda, el escalado del modelo exige incrementar el número de nodos y réplicas para consumir eficientemente los recursos adicionales. Esto incluye el uso de un escalador automático de clústeres y la configuración de métricas personalizadas.

Este enfoque integrado proporciona una solución efectiva para usuarios que busquen implementar y optimizar cargas de trabajo de grandes modelos de lenguaje en entornos escalables y de múltiples inquilinos, combinando la potencia de computación de instancias Inferentia con la flexibilidad operativa de EKS. Esto garantiza un despliegue dinámico, mejor aprovechamiento de recursos y capacidades de autosanación, con escalabilidad automática y balanceo de carga eficiente.