En un significativo avance para el campo del aprendizaje automático, Meta ha lanzado su más reciente modelo de lenguaje, Llama 3.3 70B, disponible desde hoy en Amazon SageMaker JumpStart. Este nuevo modelo promete revolucionar la forma en que se implementan las soluciones de procesamiento de lenguaje natural, al ofrecer un rendimiento comparable al de versiones más voluminisosas, pero con un uso drásticamente reducido de recursos computacionales. Esta eficiencia incrementada no solo mejora la calidad de las salidas del modelo, sino que también reduce considerablemente los costos, tornando a Llama 3.3 70B en una elección atractiva para la producción a gran escala.

Con una optimización destacada, Llama 3.3 70B logra resultados cercanos a los obtenidos por su predecesor, Llama 3.1 405B, utilizando apenas una fracción de los recursos requeridos. Según Meta, este avance permite realizar hasta cinco veces más operaciones de inferencia por el mismo costo, proporcionando así una solución más económica para las organizaciones que buscan integrar inteligencia artificial en sus procesos.

El modelo basa su estructura en una versión mejorada de los transformadores, incorporando un mecanismo de atención renovado que contribuye significativamente a la reducción de los costos de inferencia. Durante su desarrollo, Meta entrenó el modelo utilizando un extenso corpus de aproximadamente 15 billones de tokens, que incluye tanto contenido extraído de la web como más de 25 millones de ejemplos sintéticos diseñados específicamente para el perfeccionamiento de modelos de lenguaje.

Una de las características distintivas de Llama 3.3 70B es su metodología de entrenamiento, la cual integra un meticuloso proceso de afinamiento supervisado junto con aprendizaje por refuerzo a partir de comentarios humanos (RLHF). Esta estrategia permite al modelo producir salidas más alineadas con las preferencias humanas sin comprometer los altos estándares de rendimiento que se esperan. En pruebas de referencia, el modelo demostró una consistencia sobresaliente, quedando solo a un 2% de diferencia en seis de diez evaluaciones AI con respecto a su variante más grande y superándola en otras tres.

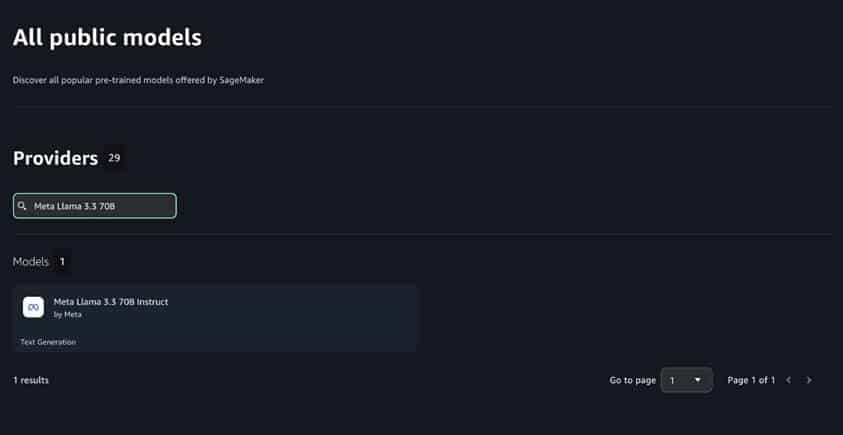

Para facilitar la adopción de Llama 3.3 70B, SageMaker JumpStart ofrece un conjunto de herramientas que permiten evaluaciones, comparaciones y selecciones eficientes de modelos preentrenados, incluyendo los de la serie Llama. Los usuarios pueden desplegar Llama 3.3 70B tanto a través de una interfaz de usuario amigable como utilizando el SDK de Python de SageMaker, lo que proporciona flexibilidad y adaptability para satisfacer diversas necesidades organizacionales.

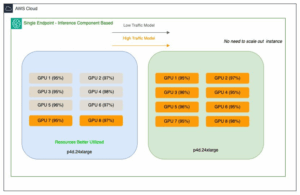

Además, las amplias capacidades del AI de SageMaker, como la carga rápida de modelos, el almacenamiento en caché de contenedores y la posibilidad de escalar a cero, permiten gestionar despliegues de manera eficiente, optimizando así las ventajas inherentes a la arquitectura de Llama 3.3 70B sin incurrir en gastos innecesarios.

Esta integración de sofisticadas características presentes en Llama 3.3 70B junto a las avanzadas herramientas de implementación de SageMaker AI establece una solución idónea para las entidades que buscan maximizar tanto el rendimiento como la eficacia en costos en sus operaciones de modelado de lenguaje.