En el dinámico mundo de la inteligencia artificial, la personalización de modelos de lenguaje para industrias específicas se ha vuelto un objetivo crucial. Aunque los modelos de lenguaje de gran tamaño (LLMs) son eficaces en un amplio espectro de tareas de lenguaje natural, su rendimiento tiende a decrecer cuando se enfrentan a dominios especializados que requieren un conocimiento más profundo y específico.

Este desafío se manifiesta claramente en la industria automotriz. Los usuarios de este sector a menudo no proporcionan los códigos específicos de diagnóstico (DTCs), que son esenciales para identificar problemas específicos en los vehículos. Códigos como el P0300, que indica un fallo genérico en el encendido del motor, o el C1201, relacionado con el sistema ABS, son fundamentales para diagnósticos acertados. Sin ellos, un modelo de lenguaje diseñado para propósitos generales podría fallar en ofrecer información adecuada, lo que podría resultar en diagnósticos incorrectos o en asesoramientos poco útiles.

La falta de especificidad en la terminología puede provocar que un modelo de lenguaje genere respuestas erróneas, en lo que se conoce como alucinaciones. Por ejemplo, ante una descripción vaga como «el motor funciona de manera irregular», sin un DTC específico, el modelo podría sugerir numerosos problemas posibles, algunos de los cuales podrían no ser pertinentes.

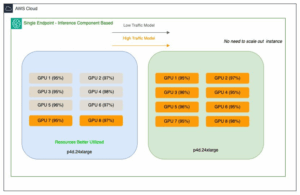

Para abordar estas limitaciones, se está adoptando cada vez más la personalización de modelos de lenguaje de menor tamaño (SLMs), que son más eficientes y económicos de entrenar y desplegar. Estos modelos compactos, que manejan entre 1 y 8 mil millones de parámetros, resultan ser altamente eficaces cuando se optimizan para dominios y tareas específicas, ofreciendo tiempos de respuesta más rápidos y requerimientos de recursos más reducidos.

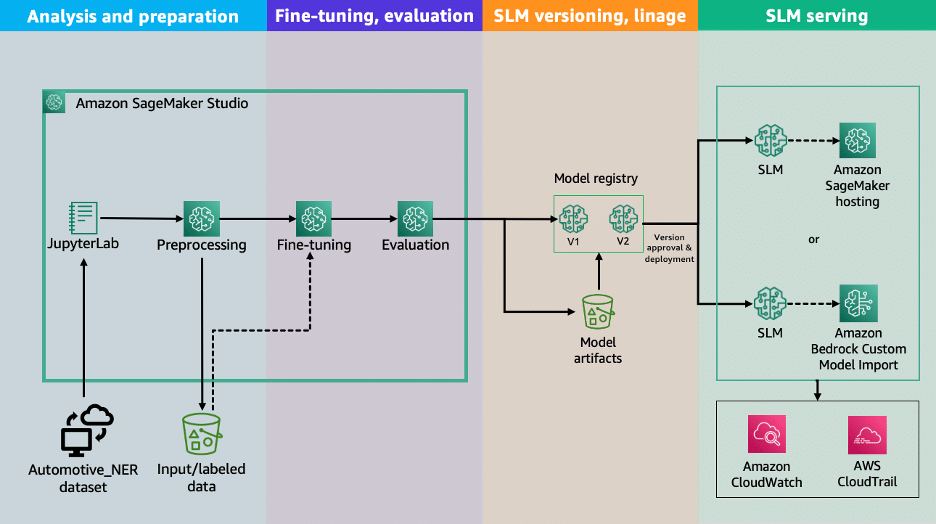

Amazon Web Services (AWS) está a la vanguardia en esta área, proporcionando herramientas como Amazon Bedrock y Amazon SageMaker, que permiten construir, entrenar y desplegar estos modelos con facilidad. Con tecnologías como la Adaptación de Bajo Rango (LoRA), es posible personalizar estos modelos para satisfacer necesidades específicas, haciendo que sus capacidades sean accesibles para un público más amplio.

En un reciente ejercicio de personalización, se ha puesto a prueba la eficiencia de los SLMs en el ámbito automotriz, optimizándolos para tareas de diagnóstico precisas. A lo largo de este proceso, desde el análisis de datos hasta la implementación y evaluación final, se ha demostrado que los SLMs personalizados superan a los LLMs de propósito general en términos de vocabulario especializado y precisión.

Este enfoque no solo es relevante para la automoción, sino que también se aplica a otros sectores que requieran terminología específica y contextualizada. El avance en la personalización de modelos de lenguaje promete ser un elemento transformador para industrias que dependen de diagnósticos precisos y respuestas rápidas, marcando un nuevo hito en el uso de inteligencia artificial adaptativa.