En un mundo donde la inteligencia artificial (IA) generativa está transformando múltiples sectores, las organizaciones buscan constantemente maneras de personalizar estas herramientas para satisfacer sus necesidades específicas. Con el lanzamiento de nuevos modelos por parte de la empresa DeepSeek, se ha abierto una puerta a la innovación en la personalización de modelos de inteligencia artificial. Sin embargo, el desafío radica en gestionar eficientemente la personalización y los recursos computacionales necesarios.

La clave para afrontar este reto parece estar en la serie de flujos de trabajo de ajuste fino preconstruidos, conocidos como «recetas», para los modelos DeepSeek-R1. En un reciente análisis, se detalla cómo estas recetas, en el contexto de Amazon SageMaker HyperPod, están reduciendo la complejidad tradicionalmente asociada a la personalización de modelos. El modelo DeepSeek-R1 Distill Qwen 7b sirve de ejemplo, logrando puntuaciones que superan el 49% en métricas de eficiencia, como la puntuación ROUGE-2.

La introducción de Amazon SageMaker HyperPod está democratizando el acceso a estas avanzadas técnicas de personalización, permitiendo que científicos de datos y desarrolladores de diversos niveles de habilidad puedan entrenar y ajustar modelos de IA generativa en cuestión de minutos. Esta herramienta simplifica tareas críticas, como la carga de conjuntos de datos y la aplicación de técnicas de entrenamiento distribuidas, eliminando gran parte del tedioso trabajo tradicionalmente asociado con configuraciones complejas de modelos.

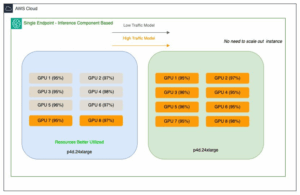

La flexibilidad y escalabilidad de esta arquitectura hacen que sea especialmente eficaz para modelos de lenguaje de gran tamaño que requieren computación distribuida. Recientemente, se han liberado nuevas recetas que admiten la personalización de seis modelos de DeepSeek, utilizando técnicas de ajuste fino supervisado y adaptaciones de bajo rango.

Un caso práctico destaca el uso en el sector salud, donde estas técnicas están siendo empleadas para desarrollar aplicaciones de asistencia médica. Al utilizar un conjunto de datos específico del ámbito médico, el modelo DeepSeek-R1 Distill Qwen 7b se ajusta finamente para ofrecer información clara y precisa a los pacientes, manteniendo el rigor clínico necesario.

Los resultados del ajuste muestran un aumento notable en la eficiencia del modelo, lo que sugiere que prolongar el entrenamiento podría mejorar aún más su rendimiento. Esta serie no solo destaca la innovación en la personalización de la IA, sino también el potencial de optimizar el uso de recursos computacionales en contextos empresariales. La capacidad de personalizar y escalar inteligentes soluciones tecnológicas para adaptarse a diversos dominios es un hito en el camino hacia la democratización y perfección de la inteligencia artificial aplicada.