En un contexto donde los modelos de base han revolucionado la inteligencia artificial, la adaptación de estos a las necesidades específicas de las empresas puede ser un desafío complejo. Muchas organizaciones buscan equilibrar el rendimiento del modelo con la eficiencia de costos, mientras incorporan conocimientos específicos del sector. En respuesta, han emergido tres técnicas efectivas: Generación Aumentada por Recuperación (RAG), el fine-tuning y un enfoque híbrido que combina ambos.

La Generación Aumentada por Recuperación mejora la IA al integrar modelos con fuentes de conocimiento externas. Por ejemplo, un chatbot de servicio al cliente que utiliza RAG puede acceder a información actualizada desde una base de datos específica, asegurando respuestas precisas. Este método implica recuperar información y luego generar respuestas mediante IA.

El fine-tuning, por su parte, permite personalizar modelos para tareas o dominios concretos con conjuntos de datos adicionales. Al ajustar el modelo con un conjunto relevante de datos etiquetados, se logran respuestas más precisas. Sin embargo, este enfoque requiere más recursos computacionales y tiempo debido al reentrenamiento del modelo.

El enfoque híbrido combina las ventajas de RAG y el fine-tuning, ofreciendo respuestas precisas y contextuales. Es especialmente útil para empresas que actualizan frecuentemente sus productos, manteniendo el modelo alineado con la información más reciente sin altos costos de reentrenamiento.

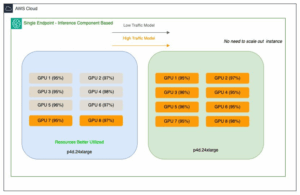

Amazon Web Services (AWS) ofrece herramientas como Amazon Bedrock y SageMaker AI para facilitar la implementación de estas técnicas. Bedrock proporciona acceso a una variedad de modelos gestionados, con soporte para RAG, mejorando los resultados del modelo con información específica del dominio. Además, simplifica la personalización mediante pre-entrenamiento y fine-tuning.

A través de un repositorio en GitHub, AWS también ofrece código listo para uso, permitiendo a las organizaciones experimentar y evaluar el rendimiento de estas técnicas según sus necesidades. Esta oportunidad de explorar RAG, fine-tuning y enfoques híbridos ayuda a las empresas a elegir la estrategia más adecuada, optimizando su inversión en inteligencia artificial.

En conclusión, mientras que RAG ofrece resultados competitivos a menor costo, el fine-tuning minimiza la latencia en las respuestas. Así, las empresas son alentadas a explorar estas técnicas para personalizar sus modelos de manera eficaz y rentable.