En un movimiento significativo para revolucionar el preentrenamiento de modelos de lenguaje de gran escala, Meta, en colaboración con el equipo de PyTorch, ha introducido la innovadora biblioteca torchtitan. Esta herramienta ha sido diseñada para mejorar la eficiencia del preentrenamiento de arquitecturas de modelos similares a Meta Llama 3, utilizando instancias p5.48xlarge de Amazon SageMaker equipadas con 8 GPUs Nvidia H100. Gracias a estas innovaciones, se consiguió un incremento del 38.23% en la velocidad del entrenamiento en comparación con el enfoque tradicional.

El preentrenamiento de modelos de lenguaje masivos es esencial para el desarrollo de sistemas de inteligencia artificial que puedan comprender y generar texto con un nivel de sofisticación casi humano. Este proceso implica exponer a los modelos a grandes volúmenes de datos diversos para construir capacidades fundamentales de conocimiento y razonamiento. Con torchtitan, este proceso se optimiza a través de funciones avanzadas como FSDP2, integración con torch.compile y soporte para operaciones lineales FP8.

Una de las características destacadas del enfoque FSDP2 es su capacidad para ofrecer una mayor flexibilidad en la manipulación de parámetros, mejorando así la eficiencia del entrenamiento en entornos distribuidos al gestionar cada parámetro individualmente. Simultáneamente, la compatibilidad con torch.compile mediante compilación JIT optimiza los núcleos de PyTorch, incrementando el rendimiento con mínimas modificaciones en el código.

Torchtitan también implementa operaciones en FP8, lo que reduce significativamente el uso de memoria y mejora el rendimiento. Esta característica, habilitada por la librería torchao, permite una precisión reducida sin comprometer la precisión del modelo, como se evidenció durante un entrenamiento de prueba a 2,000 pasos.

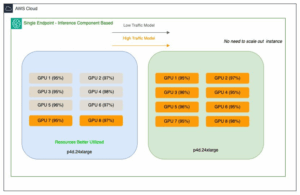

Amazon SageMaker juega un papel crucial al proporcionar un entorno totalmente administrado que facilita el preentrenamiento a gran escala. Su capacidad de escalabilidad automática y la integración sencilla de torchtitan aseguran un entrenamiento eficiente, con soporte integrado para TensorBoard que permite monitorear el progreso del entrenamiento en tiempo real.

Los resultados de estas optimizaciones son evidentes en los incrementos de rendimiento observados: torch.compile proporcionó una mejora del 10.67%, mientras que las operaciones lineales FP8 llevaron este número al 33%, alcanzando un 38.23% al incluir FP8 all-gather en comparación con la línea base del entrenamiento. Estos avances no han comprometido la calidad del modelo, manteniendo curvas de pérdida consistentes en diversas configuraciones.

Con estos logros, Meta y PyTorch han demostrado cómo la combinación de estrategias de optimización puede potenciar de manera significativa la eficiencia del entrenamiento en modelos de gran envergadura, abriendo nuevas posibilidades para el desarrollo de herramientas de inteligencia artificial más poderosas y adaptables.